Tích hợp của AI với công nghệ tiêu dùng làm dấy lên mối lo ngại về đạo đức

Trong bối cảnh kỷ nguyên số đạt được những bước tiến bộ, việc tích hợp trí tuệ nhân tạo (AI) với công nghệ tiêu dùng đang gây ra những lo ngại đáng kể về đạo đức. Sau khi gần như khai thác hết các nguồn dữ liệu tiếng Anh công khai, các đại công ty công nghệ hiện đang chuyển sang các thiết bị điện tử cá nhân và truyền thông xã hội để huấn luyện các mô hình AI. Sự thay đổi này đã gây ra sự khó chịu cho công chúng, với nỗi lo về xâm phạm quyền riêng tư ngày càng gia tăng.

Một ví dụ gần đây về xu hướng này là Apple đã tiết lộ những tiến bộ đáng kể về AI, đặc biệt là đối với trợ lý kỹ thuật số Siri của hãng này.

Tại Hội nghị Các nhà phát triển Toàn cầu năm 2024 của Apple hôm 10/06, đại công ty công nghệ đã tuyên bố rằng phiên bản Siri cập nhật hiện hiểu cú pháp ngôn ngữ tự nhiên theo một cách tương tự như ChatGPT, cho phép các chức năng như chỉnh sửa ảnh nhanh, soạn thư điện tử cũng như tạo biểu tượng cảm xúc và hình ảnh thông qua các khẩu lệnh đơn giản. Các cải tiến này chỉ dành riêng cho các thiết bị như iPhone 15 Pro, máy điện toán bảng có vi mạch bán dẫn (chip) dòng M và máy điện toán Mac được trang bị bộ xử lý tân tiến.

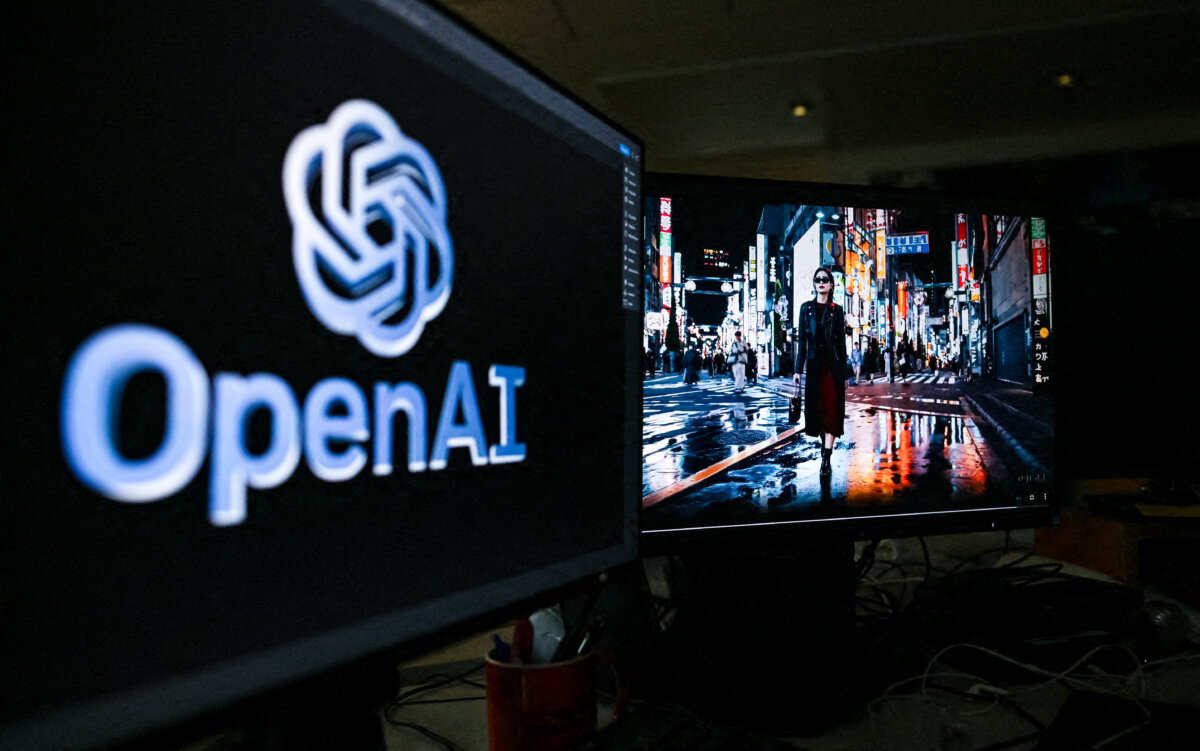

Tại hội nghị, Apple thông báo rằng họ cũng đã hợp tác với OpenAI để tích hợp ChatGPT trực tiếp vào Siri, tận dụng GPT-4 làm công cụ AI cơ sở.

Trong bài diễn văn quan trọng tại hội nghị, ông Craig Federighi, phó chủ tịch cấp cao về công nghệ phần mềm của Apple, đã nhấn mạnh tầm quan trọng của quyền riêng tư về dữ liệu trong phạm vi AI. Theo truyền thống, Apple đã bảo vệ quyền riêng tư đó bằng quy trình xử lý dữ liệu trên thiết bị, giúp lưu giữ dữ liệu trên thiết bị thay vì truyền dữ liệu đến các máy chủ bên ngoài.

Ông Federighi lưu ý rằng nhiều mô hình AI tạo sinh của Apple chạy hoàn toàn trên thiết bị, duy trì quyền riêng tư dữ liệu mà không phụ thuộc vào việc xử lý điện toán đám mây. Tuy nhiên, ông cho biết, đối với các yêu cầu phức tạp hơn thì đôi khi cần truy cập vào các mô hình dựa trên máy chủ. Ông cho biết, trong những trường hợp đó, Điện toán Đám mây Riêng (Private Cloud Compute) mới của Apple sẽ bảo đảm rằng dữ liệu được xử lý trên các máy chủ đám mây của họ được bảo vệ một cách minh bạch và có thể được xác minh độc lập.

Phản ứng của công chúng và chỉ trích của người có ảnh hưởng

Bất chấp sự đảm bảo của Apple, những người hoài nghi vẫn bày tỏ lo ngại rằng thông tin cá nhân có thể bị các tập đoàn khai thác để huấn luyện AI hoặc các thí nghiệm không được tiết lộ.

Sau hội nghị của Apple, một trong những người chỉ trích có ảnh hưởng nhất có thể là của Tổng giám đốc Tesla Elon Musk. Ông đã lớn tiếng chỉ trích hành động này trên X (trước đây gọi là Twitter) để bày tỏ lo ngại về các vi phạm an ninh. Ông còn đề nghị cấm các thiết bị Apple trong các cơ sở của công ty ông trong bối cảnh lo ngại rằng việc tích hợp OpenAI vào hệ sinh thái của Apple có thể dẫn đến lạm dụng dữ liệu nhạy cảm.

Lời chỉ trích của ông Musk còn đề cập đến tính minh bạch trong việc xử lý dữ liệu giữa Apple và OpenAI. Ông bác bỏ quan điểm cho rằng Apple có thể giám sát cách OpenAI sử dụng dữ liệu sau khi được truyền tải.

Ông Musk chia sẻ trên X: “Vấn đề với việc ‘đồng ý’ chia sẻ dữ liệu của quý vị: không ai thực sự đọc các điều khoản và điều kiện.”

Vấn đề này được nhấn mạnh sau một vụ việc gần đây liên quan đến nữ diễn viên Scarlett Johansson. Hồi tháng Năm, cô đe dọa sẽ kiện OpenAI, cáo buộc rằng giọng nói có tên Sky trong sản phẩm ChatGPT của họ nghe rất giống giọng của cô.

OpenAI được cho là đã tiếp cận cô Johansson để tìm cách sử dụng giọng nói của cô cho AI, nhưng cô đã từ chối lời đề nghị này. Nhiều tháng sau, cô Johansson và những người khác nhận thấy giọng nói có sự giống nhau, khiến cô choáng váng và tức giận, và phải tìm đến luật sư.

Kể từ đó, OpenAI đã tạm dừng việc sử dụng giọng nói của Sky và phủ nhận mục đích bắt chước giọng nói của nữ diễn viên này. Họ viện dẫn lý do riêng tư nên không tiết lộ danh tính thực sự của diễn viên lồng tiếng. Vụ việc đã làm dấy lên các cuộc thảo luận về tiêu chuẩn đạo đức trong việc sao chép giọng nói AI.

Ngụ ý sâu xa và các vụ kiện tụng

Cuộc tranh luận mở rộng ra ngoài Apple và OpenAI với những lo ngại về việc dữ liệu truyền thông xã hội được sử dụng làm tài nguyên để huấn luyện AI. Gần đây, Meta—công ty mẹ của Facebook và Instagram— đã thông báo rằng, bắt đầu từ ngày 26/06, dữ liệu người dùng từ Facebook và Instagram tại Vương quốc Anh và châu Âu sẽ được sử dụng để đào tạo mô hình ngôn ngữ AI Llama của Meta.

Meta khẳng định rằng dữ liệu huấn luyện sẽ bao gồm nội dung và ảnh được đăng công khai, cũng như các tương tác với chatbot AI nhưng sẽ không bao gồm tin nhắn riêng tư của người dùng.

Meta cho biết người dùng có thể chọn không cho phép hãng này dùng dữ liệu người dùng để huấn luyện Llama.

Trong một thư điện tử gửi tới người dùng Facebook và Instagram, công ty này cho biết: “Quý vị có quyền phản đối cách mà thông tin của quý vị được sử dụng cho những mục đích này. Nếu sự phản đối của quý vị được xác nhận, việc này sẽ được áp dụng kể từ đó trở đi.”

Mối lo ngại về những hoạt động này đã thúc đẩy NOYB, một nhóm bảo vệ quyền kỹ thuật số của châu Âu, đệ đơn khiếu nại lên 11 cơ quan giám sát quyền riêng tư quốc gia về các kế hoạch huấn luyện AI của Meta, theo thông báo hôm 06/06 của tổ chức phi lợi nhuận này.

Do những khiếu nại trên, Ủy ban Bảo vệ Dữ liệu Ireland, cơ quan quản lý chính của Meta, đã yêu cầu công ty công nghệ này tạm dừng chương trình huấn luyện Llama sử dụng nội dung trên truyền thông xã hội.

Trong bản cập nhật hôm 14/06, Meta bày tỏ sự thất vọng và gọi việc tạm dừng này là “một bước lùi cho sự đổi mới của châu Âu.”

Rủi ro của AI trong tay các chế độ độc tài

Trong khi công chúng ngày càng lo ngại về việc các đại công ty công nghệ sử dụng AI sai mục đích, thì cũng có một nỗi lo cấp bách không kém là các chế độ độc tài và những kẻ vô đạo đức sử dụng AI để truyền bá các hệ tư tưởng có hại, tạo ra thông tin sai lệch, và thao túng nhận thức của công chúng.

Hôm 06/06, ba nhà lập pháp Hoa Kỳ—Chủ tịch Ủy ban Tình báo Thượng viện, Dân biểu Mark Warner (Dân chủ-Virginia); người đứng đầu Ủy ban đặc biệt của Hạ viện về Trung Quốc, Dân biểu Raja Krishnamoorthi (Dân Chủ-Illinois); và chủ tịch Hội nghị Đảng Cộng Hòa tại Hạ viện, Dân biểu Elise Stefanik (Cộng Hòa–New York)—đã bày tỏ mối lo ngại nghiêm trọng về ứng dụng tổng hợp tin tức NewsBreak.

Ông Satoru Ogino, một kỹ sư điện tử người Nhật, cho biết ĐCSTQ sử dụng “AI để tạo ra thông tin sai lệch và định hình dư luận.”

“Nếu không có các kỹ năng tư duy phản biện mạnh mẽ, các cá nhân sẽ dễ bị tấn công trước những chiến dịch tin giả tinh vi này. Các chính phủ phải loại bỏ phần mềm và phương tiện truyền thông được kết nối với ĐCSTQ để bảo vệ ngôn luận của công chúng và duy trì tính toàn vẹn của thông tin,” ông nói.

Khai thác AI để định hình nhận thức toàn cầu

Trong một bài đăng trên blog hôm 30/05, OpenAI đã trình bày chi tiết về việc lạm dụng công nghệ AI của các tổ chức nhà nước và tổ chức tư nhân để thao túng các nội dung toàn cầu. Trong ba tháng qua, theo OpenAI, các cuộc điều tra của họ đã tiết lộ năm hoạt động bí mật sử dụng công nghệ của OpenAI. Các hoạt động này nhằm mục đích kiểm soát ngôn luận của công chúng và thống trị dư luận quốc tế mà không tiết lộ nguồn gốc hoặc mục tiêu thực sự của họ.

Các hoạt động bí mật này trải dài trên nhiều quốc gia, bao gồm Nga, Trung Quốc, và Iran, thậm chí còn liên quan đến một công ty tư nhân của Israel. Họ tận dụng khả năng của các mô hình ngôn ngữ tân tiến của OpenAI cho nhiều mục đích khác nhau: từ tạo ra các bài đánh giá và bài viết giả mạo đến tạo hồ sơ truyền thông xã hội và từ trợ giúp lập trình và gỡ lỗi robot đến dịch và hiệu đính văn bản.

Báo cáo đặc biệt nhấn mạnh chiến dịch Spamouflage của Trung Quốc. Chiến dịch này sử dụng AI để giám sát các hoạt động truyền thông xã hội công cộng. Hoạt động này đã tạo ra các tin nhắn giả mạo bằng nhiều ngôn ngữ, bao gồm tiếng Hoa, tiếng Anh, tiếng Nhật, và tiếng Hàn, sau đó lan truyền chúng trên các nền tảng như X, Medium, và Blogspot. Hoạt động của họ mở rộng sang việc quản lý cơ sở dữ liệu và thao túng mã nguồn trang web, điển hình là việc họ sử dụng tên miền không xác định revescum[.]com.

Nhóm Bad Grammar của Nga và các hoạt động Doppelganger, cùng với Liên minh Truyền thông Ảo Quốc tế từ Iran, cũng bị nêu tên vì sử dụng sai mục đích AI để phát tán tin tức sai lệch và nội dung cực đoan bằng nhiều ngôn ngữ khác nhau. Các nỗ lực tuyên truyền của họ ở khắp các nền tảng kỹ thuật số, bao gồm Telegram, X, và Facebook.

Cũng trong tháng Năm, Viện Chính sách Chiến lược Úc đã công bố một báo cáo có tựa đề “Sự thật và Thực tế Mang đặc sắc Trung Quốc.”

Nghiên cứu toàn diện này đã phác thảo cách thức bộ máy tuyên truyền của ĐCSTQ sử dụng các công ty Trung Quốc tư nhân trong các lĩnh vực như trò chơi di động, AI, thực tế ảo, và các nền tảng bán lẻ trực tuyến ở hải ngoại. Các tổ chức này thu thập dữ liệu rộng rãi về các cá nhân ở cả Trung Quốc và trên toàn cầu. Sau đó, dữ liệu này được sử dụng để điều chỉnh và truyền bá các bài tường thuật có lợi cho ĐCSTQ.

Bản tin có sự đóng góp của Ellen Wan và Kane Zhang

Mới nhất

Mới nhất

Tiêu điểm

Tiêu điểm

Bình luận

Bình luận

Email

Email