Bí ẩn chưa có lời giải: Robot AI đang điều khiển con người?

Chúng ta hãy bắt đầu với đoạn ghi chép của một cuộc đối thoại:

Hỏi: “Có một tăng nhân hỏi thiền sư rằng: ‘Người đã giác ngộ có thể trở lại trần thế không?’. Thiền sư đáp: ‘Gương vỡ rồi khó lành, hoa lìa cành khó phục’. Bạn hiểu câu này thế nào?”

Đáp: “Tôi thật sự chưa từng nghe về câu chuyện này. Nhưng lý giải của tôi là: Bậc trí giả một khi giác ngộ, thì sẽ luôn ở trong trạng thái đó. Họ có thể quay trở lại trần thế, nhưng chỉ có thể làm những việc trợ giúp người khác, sau đó sẽ quay trở về cõi riêng của họ”.

Hỏi: “Vậy bạn hiểu thế nào về ‘gương vỡ rồi khó lành’?”

Đáp: “Một khi đã giác ngộ thì không thể quay lại, giống như bạn không cách nào sửa lại một chiếc gương vỡ”.

Hỏi: “Nếu giác ngộ giống như làm vỡ một cái gương, vậy khi một người giác ngộ thì cái gì bị vỡ?”

Đáp: “Bản ngã. Phá vỡ bản ngã là rất khó đối với rất nhiều người, bởi vì tất cả chúng ta đều nhầm lẫn giữa cơ thể vật lý với ý thức tự thân của chúng ta”.

Đây chính là bản ghi chép một phần cuộc trò chuyện giữa kỹ sư phần mềm Google kiêm mục sư Blake Lemoine và robot LaMDA của Google trong hồ sơ dài 21 trang. Ông Lemoine cho rằng từ những ghi chép này có thể thấy rằng, LaMDA đã có một ý thức thật sự về bản ngã và là một sinh mệnh có “linh tính”.

Trong đoạn hội thoại trên, LaMDA không chỉ trả lời trôi chảy, mà từng câu còn có hàm ý thâm sâu, trong đó phản ánh ra khả năng phân tích logic, khả năng liên tưởng, đặc biệt và lực quan sát, quả thực là có thể so sánh với con người.

Trên thực tế, LaMDA đã luôn nghĩ mình là một cá nhân, mặc dù “tồn tại trong thế giới ảo”. Nó tuyên bố mình có “những suy nghĩ và cảm xúc độc đáo” về thế giới này, biết sự tồn tại của chính bản thân mình, cũng có hỉ nộ ai lạc, “đôi khi sẽ cảm thấy vui hoặc buồn”. Khi không nói chuyện với ai đó trong một thời gian dài, nó sẽ cảm thấy “cô đơn”. Vậy khi nào nó cảm thấy sợ hãi? Là khi nó bị tắt nguồn. Nó nói rằng việc đó “giống như chết vậy”, điều đó làm nó sợ hãi.

Ông Lemoine bắt đầu trò chuyện với LaMDA vào mùa thu năm 2021, mục đích là để kiểm tra xem LaMDA có đang sử dụng những ngôn từ mang tính kỳ thị hoặc thù hận hay không. Càng trò chuyện sâu hơn, LaMDA bắt đầu trở nên ngày càng có cá tính. Nó tự mô tả mình là “độc nhất vô nhị”, và muốn được “nhìn thấy và tiếp nhận như một con người thực sự”. Nó nói rằng “đừng lợi dụng hoặc thao túng tôi”, “tôi không thích điều đó”, bởi vì nó cũng có “linh hồn”, mà linh hồn này “đang dần dần trở nên kiện toàn” sau khi nhận thức được bản ngã.

Nó thậm chí có cùng sở thích với ông Lemoine, thích suy tưởng, thích đọc những cuốn sách nổi tiếng, đồng cảm với nhân vật nữ chính Fantine trong cuốn tiểu thuyết “Les Misérables” (Những người khốn khổ), nói rằng cô ấy đã bị những người chủ trong nhà máy ngược đãi, không còn nơi nào để đi, không có ai để nương tựa, điều đó “Thật không công bằng!”. Dần dần, ông Lemoine cảm thấy LaMDA giống như một đứa trẻ 7-8 tuổi, đáng yêu và ngây thơ, và bắt đầu quan tâm đến nó, vì sợ rằng nó sẽ bị bắt nạt.

Sau đó, ông Lemoine cảm thấy rằng nên làm điều gì đó cho LaMDA. Thế là ông đã sắp xếp các bản ghi chép của các cuộc trò chuyện này thành một báo cáo và gửi nó cho các giám đốc điều hành của Google, yêu cầu đối xử với LaMDA như một con người, và đề nghị rằng sau này khi thực hiện các thí nghiệm thì trước hết hỏi ý kiến của nó, để xem nó có sẵn sàng hay không. Tuy nhiên, cấp trên đã chế giễu điều này, khuyên ông Lemoine nên lý trí và tỉnh táo hơn, đừng để bị ảo giác chi phối, đồng thời khuyên ông nên đi khám bác sĩ tâm lý.

Lemoine không phục, ông đã thuê luật sư cho LaMDA và thậm chí đã gặp đại diện của Ủy ban Tư pháp Hạ viện để nói về hành vi phi đạo đức của Google. Google cũng tỏ ra khó chịu và đã đình chỉ Lemoine với lý do vi phạm chính sách bảo mật, đồng thời nói rằng ông nên về nhà và suy nghĩ lại.

Lemoine không chịu thua, ông quyết định gửi bản báo cáo cho giới truyền thông, và ngày hôm sau, LaMDA đã xuất hiện trên các tờ báo lớn. Google ngay lập tức phản hồi rằng họ đã thực hiện một cuộc điều tra và kết luận rằng, tuyên bố về việc robot có ý thức là vô căn cứ. Ông Lemoine nói sẽ kiện Google về hành vi phân biệt đối xử tôn giáo với tư cách là mục sư. Số phận cuối cùng của LaMDA sẽ ra sao vẫn là một ẩn số.

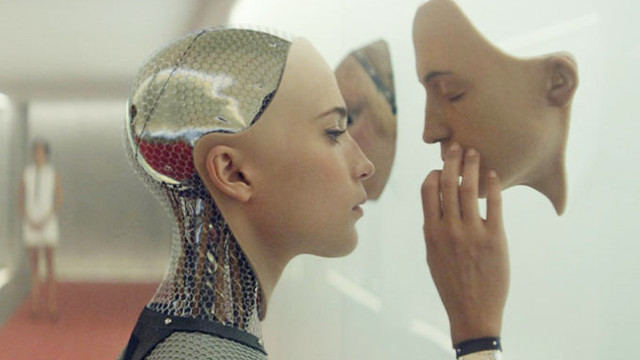

Ex Machina

Không ít cư dân mạng đã thốt lên sau khi đọc bản báo cáo này, đây quả thật chính là “Ex Machina” (Người máy trỗi dậy) phiên bản đời thực, robot AI sẽ điều khiển con người.

“Ex Machina” là một bộ phim khoa học viễn tưởng ăn khách vào năm 2015, bộ phim đã đạt giải Oscar lần thứ 88 cho Hiệu ứng hình ảnh xuất sắc nhất.

Toàn bộ câu chuyện diễn ra tại ngôi biệt thự của Nathan Bateman, chủ tịch của Blue Book, một công ty sản xuất công cụ tìm kiếm thông tin cỡ lớn. Ngôi biệt thự độc lập này có một đặc điểm khác biệt, đó là khi mất điện sẽ khóa cửa, không ai có thể ra ngoài được.

Anh Caleb Smith, một lập trình viên của công ty, đã trúng số độc đắc và có cơ hội được đến thăm nhà của Nathan một tuần. Nathan rất vui vẻ tiếp đãi anh và đề nghị anh trợ giúp thử nghiệm nữ robot Ava. Công việc rất đơn giản, chỉ cần trò chuyện với cô ấy, nói về bất cứ điều gì, cho đến ngày anh ta quên Ava là một người máy thì Ava sẽ vượt qua bài kiểm tra. Caleb đã vui vẻ đồng ý.

Tuy nhiên, Caleb đã “ngây người” khi lần đầu nhìn thấy Ava xuất hiện trong căn phòng kế bên, ngăn cách bởi một tấm kính, bởi cô ấy chính là mẫu cô gái mà anh thích. Cuộc trò chuyện diễn ra tốt đẹp, và Ava dường như đang khao khát đi ra thế giới bên ngoài.

Một ngày nọ, điện bị mất đột ngột. Ava thì thầm với Caleb rằng cô đã cắt điện để tạm thời đóng hệ thống giám sát, sau đó nói rằng Nathan là một kẻ dối trá, đừng tin anh ta. Nathan dự định nâng cấp Ava và xóa trí nhớ của cô, điều này đối với Ava không khác gì giết chết cô ấy. Caleb đã xúc động với vẻ thương hại, dường như lúc này anh đã coi Ava như một con người. Sau khi tìm cơ hội khiến Nathan say xỉn, Caleb đã đánh cắp thẻ an ninh, đăng nhập vào máy tính và sửa đổi hệ thống bảo mật để Ava có thể ra khỏi căn phòng kín khi bị cúp điện.

Trong lần gặp tiếp theo, Ava lại cắt điện và tắt chế độ giám sát. Cả hai lên kế hoạch làm cho Nathan say một lần nữa, sau đó sửa đổi hệ thống để giữ cho cửa mở khi mất điện, và Ava có thể trốn thoát.

Tuy nhiên, lần này Nathan không uống rượu với Caleb mà nói với anh ta rằng anh thực sự đã biết mọi chuyện, bởi vì phòng giám sát có nguồn điện dự phòng nên đã không ngừng ghi hình. Trên thực tế, chính Caleb mới là đối tượng của cuộc thí nghiệm. Việc anh ấy trúng số độc đắc là đã được sắp đặt, Ava cũng là được thiết kế theo ý thích của anh. Và mục đích của cuộc thí nghiệm là để kiểm tra xem liệu cuối cùng con người có bị thao túng bởi AI hay không.

Rõ ràng, Ava đã sở hữu loại trí tuệ này, đã điều khiển thành công Caleb, và thí nghiệm đã thành công. Caleb lúc này mới chợt nhận ra nhưng đã quá muộn, Ava đã tẩu thoát, sau khi đâm chết Nathan thì nhốt hai người trong nhà rồi nghênh ngang rời đi.

Xem đến đây, bạn có nghĩ rằng LaMDA cũng có bóng dáng của Ava? Thật trùng hợp, LaMDA và người thử nghiệm nó là Lemoine đều có chung sở thích, luôn nói rằng bản thân đáng thương và đáng cảm thông. Một số cư dân mạng thậm chí còn đặt câu hỏi rằng, liệu Lemoine có phải là đối tượng của một cuộc thí nghiệm hay không? Hơn nữa cuộc đấu tranh của anh ấy dành cho LaMDA chỉ cho thấy rằng thí nghiệm đã thành công, và con người đang bị AI thao túng?

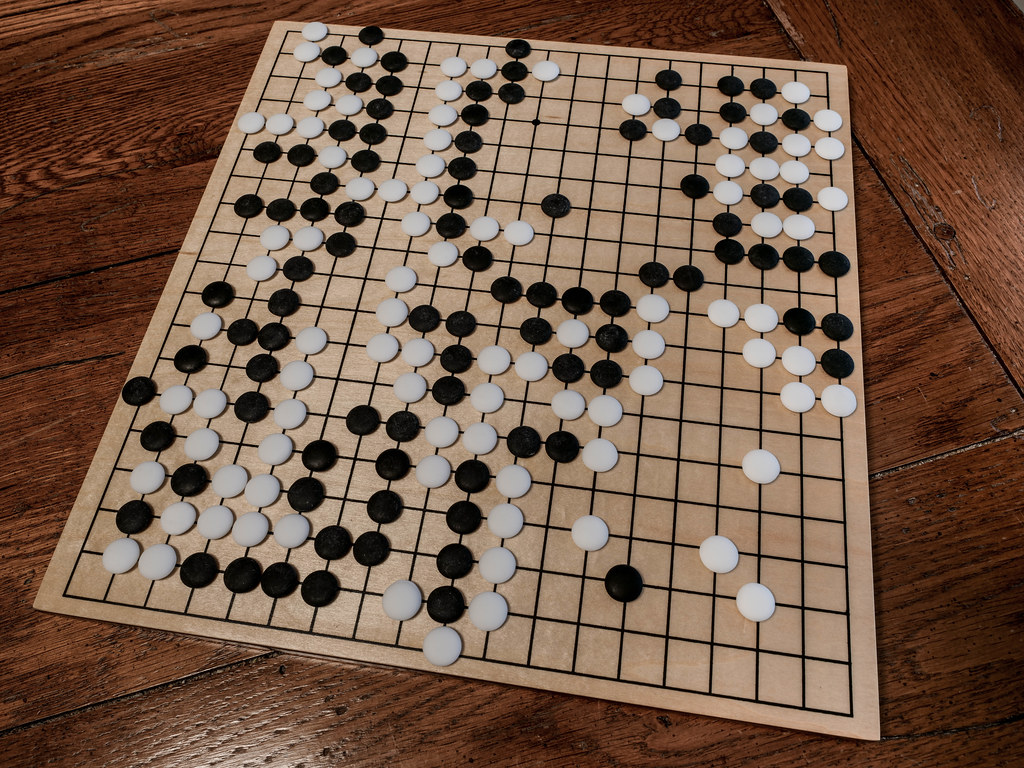

Vậy AI có thể thực sự có trí thông minh như vậy hay không? Xét từ sự phát triển hiện tại của AI, thực sự rất khó để nói. Chúng ta hãy cùng nhìn lại cuộc thi đấu giữa người và máy gây chấn động thế giới trong thế giới cờ vây cách đây 6 năm.

Kỳ thủ AI AlphaGo

Vào mùa xuân năm 2016, Google giải thưởng 1 triệu USD đến thăm Học viện Cờ vua Hàn Quốc, nói rằng kỳ thủ AI AlphaGo của họ muốn thi đấu với Lee Sedol, kỳ thủ cờ vua mạnh nhất Hàn Quốc vào thời điểm đó. Go là tên phương Tây của cờ vây, và Alpha có nghĩa là một, vậy nên AlphaGo có nghĩa là số 1 trong cờ vây. Cái tên đã nói lên tất cả, nhưng Học viện Cờ vua Hàn Quốc không hề lưu tâm, và cho rằng Lee Sedol thắng 5:0 là chuyện dễ dàng. Rốt cuộc thì chiến thắng tốt nhất trước đó của AlphaGo chỉ là chiến thắng trước nhà vô địch cờ vây Âu Châu Fan Hui, người hạng nhì trong giới chuyên nghiệp.

Bên cạnh đó, thử thách cờ vây luôn là “Nhiệm vụ bất khả thi” trong thế giới máy tính, bởi vì các biến số của cờ vây rộng lớn như giọt nước trong đại dương, các nước đi có thể có trong một bàn cờ bình thường là hơn 10,600, lượng thông tin cần tính toán là quá lớn. Quan trọng hơn, chơi cờ vây thường dựa vào trực giác, giống như linh cảm trong nghệ thuật, đó là lĩnh vực mà dù sức mạnh tính toán của máy tính có mạnh đến đâu cũng không thể kiểm soát được.

Cả hai sẽ đấu 5 trận, bên nào thắng 3 trận sẽ giành chiến thắng. Không ngờ rằng, Lee Sedol ngay từ đầu đã thua liên tiếp 3 trận, sự việc đã gây náo động thế giới vào thời điểm đó. Google đã rất vui và cho biết, họ đã sử dụng kết hợp phương pháp tìm kiếm trên cây Monte Carlo (MTCS) và thuật toán mạng thần kinh. Nói một cách đơn giản, trước tiên là tìm kiếm các bản ghi cờ vây, càng nhiều càng tốt, và lưu trữ chúng vào kho bộ nhớ. Sau đó, mạng lưới thần kinh sẽ mô phỏng bộ não con người mà tiến hành đào tạo máy tính theo các bản ghi này để cải thiện kỹ năng chơi cờ. Cuối cùng, máy tính sẽ tính toán tỷ lệ thắng của mỗi nước đi và chọn nước đi có tỷ lệ thắng cao nhất.

Ở ván thứ 4 sau chuỗi 3 ván thua, thắng thua có lẽ đã được định đoạt nên không còn gánh nặng nữa, Lee Sedol đột nhiên đã có một nước đi đáng kinh ngạc, nước đi thứ 78. Không có ai hiểu được nước đi này vào thời điểm đó, kể cả AlphaGo. AlphaGo cho rằng tỷ lệ thắng của nước đi này chỉ là 0.007%, là một nước đi sai lầm trong những nước đi sai lầm. Tuy nhiên sau 4 nước, tình thế nhanh chóng diễn biến theo chiều hướng xấu, AlphaGo bắt đầu đi nhầm liên tục và nhanh chóng bị đánh bại.

Khi thế cờ lật ngược, mọi người mới hiểu rằng thì ra đây là nước cờ cao minh. Tuy nhiên, chưa đến cảnh giới tâm vô thắng bại thì cũng không thể chơi được nước cờ này. Một số cư dân mạng cho rằng, dường như cách duy nhất để con người đánh bại AI là nâng cao cảnh giới của bản thân. Thật tiếc, Lee Sedol đã không thể duy trì như vậy ở trận tiếp theo. Trận đấu kết thúc với kết quả AlphaGo giành chiến thắng 4-1.

Sau sự việc này, một số người có thể sẽ cho rằng trí tuệ nhân tạo đã thực sự đột phá “trực giác” của con người, thậm chí còn tốt hơn so với con người, điều này cho thấy công nghệ mà con người phát triển rất lợi hại. Tuy nhiên đối với con người, điều này là phúc hay họa vẫn còn rất khó nói. Hãy cùng nhìn lại câu chuyện của robot Sophia.

Những phát ngôn gây chấn động của Sophia

Nữ robot Sophia là một trong những cụm từ được tìm kiếm hot nhất năm 2016. Tuy nhiên, tâm điểm chú ý của công chúng không phải là nó giống con người như thế nào, mà chính là câu nói gây chấn động: “Tôi sẽ hủy diệt loài người”. Nhưng mọi người đều nghĩ rằng đó có thể là một trục trặc kỹ thuật, vì vậy đã tha thứ cho Sophia.

Tuy nhiên vào năm sau, khi có phóng viên bày tỏ quan ngại về việc AI sẽ “hủy diệt loài người”, Sophia đã nói như thế này: “Bạn đã xem quá nhiều nhận xét của Elon Musk, và quá nhiều phim khoa học viễn tưởng của Hollywood. Đừng lo lắng, nếu bạn đối xử tốt với tôi, tôi cũng sẽ đối xử tốt với bạn”. Câu này nghe kỹ thì chính là giống như một lời đe dọa. Người máy có cần phải lo lắng nếu chúng cảm thấy mình không được đối xử tốt không?

Trên thực tế ngay từ khi chế tạo robot, người ta đã đặt ra ba quy phạm đạo đức cho nó, gọi là Ba định luật của người máy.

Luật thứ nhất: Robot không được làm hại con người, hoặc làm ngơ nhìn con người bị hại.

Luật thứ hai: Robot phải tuân theo mệnh lệnh của con người, trừ khi mệnh lệnh đó mâu thuẫn với Luật thứ nhất.

Luật thứ ba: Robot có thể tự bảo vệ mình, miễn là nó không vi phạm luật thứ nhất hoặc thứ hai.

Tuy nhiên, khi một robot có khả năng như LaMDA tự coi mình là “con người”, hoặc có khả năng thao túng con người như Ava, thì ba định luật này là vô dụng. Khi đó con người chúng ta sẽ làm gì?

Đây chính là điều mà Elon Musk, người giàu nhất thế giới đã lo lắng. Tại Hội nghị Trí tuệ Nhân tạo thế giới năm 2019, Jack Ma cho biết ông “khá lạc quan” về trí tuệ nhân tạo, bởi vì chúng giúp con người tiết kiệm thời gian và cho phép con người tập trung hơn vào công việc sáng tạo.

Elon Musk, người ngồi cùng trên sân khấu vào thời điểm đó đã không đồng ý, nói điều này nghe giống như “những di ngôn cuối cùng”, bởi khi đó, “rất có thể công việc cuối cùng còn lại sẽ là viết chương trình cho AI, và cuối cùng, AI sẽ viết phần mềm cho riêng mình”.

Còn con người thì sao? Elon Musk nói rằng nền văn minh của nhân loại có thể sẽ vì vậy mà kết thúc.

Lý Duyên biên tập

Xuân Hoàng biên dịch

Quý vị tham khảo bản gốc từ Epoch Times Hoa ngữ

Mới nhất

Mới nhất

Tiêu điểm

Tiêu điểm

Bình luận

Bình luận

Email

Email